8月4日報道,今天,騰訊混元一口氣開源4款小尺寸模型,參數分別為0.5B、1.8B、4B、7B,消費級顯卡即可運行。

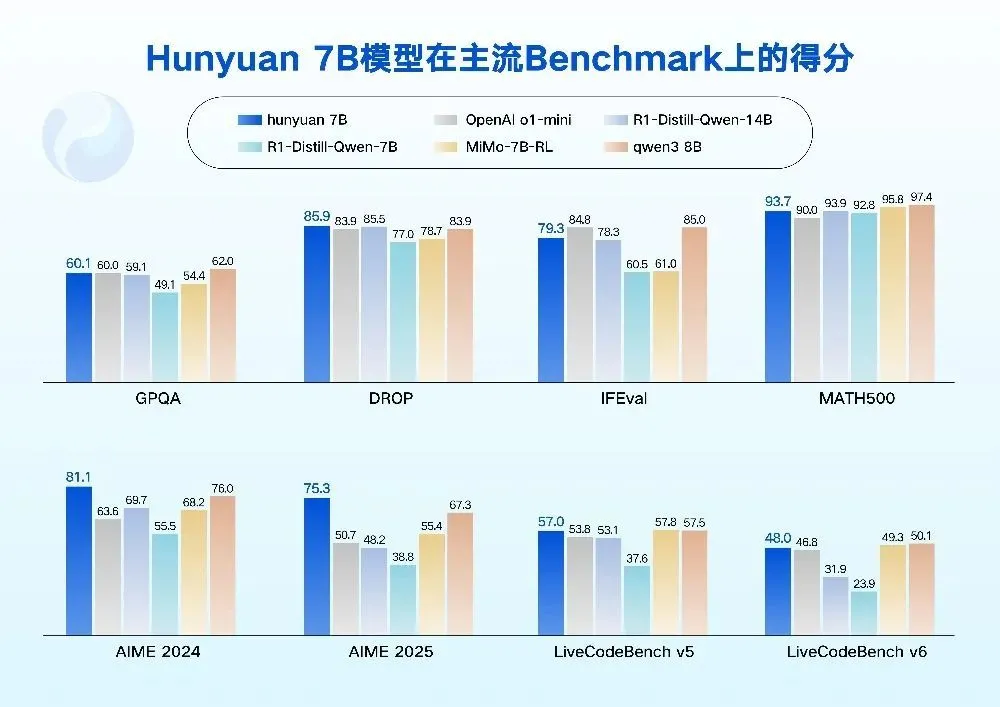

在性能上,Hunyuan 7B在不僅在數學能力上超越了OpenAI o1-mini和Qwen3-8B,在除IFEVal榜單外,均超越OpenAI o1-mini。

模型原生上下文256k,可以一次讀完3本《哈利波特》。目前已在微信讀書、騰訊會議等多個騰訊應用中落地。

這4款小尺寸模型單卡就可以部署,適用于筆記本電腦、手機、智能座艙、智能家居等低功耗場景,且支持垂直領域低成本微調。

目前,4個模型均在Github和Hugging Face等開源社區上線,Arm、高通、Intel、聯發科技等多個消費級終端芯片平臺也都宣布支持部署。

騰訊混元官網體驗地址:

https://hunyuan.tencent.com/

Github地址:

https://github.com/Tencent-Hunyuan

Hugging Face地址:

https://huggingface.co/tencent

01 .

數學能力超越Qwen3-8B

能一口氣讀3本《哈利波特》

騰訊新開源的4個模型屬于融合推理模型,并且具備快思考和慢思考兩種模式。其中快思考模式提供簡潔、高效的輸出;而慢思考涉及解決復雜問題,具備更全面的推理步驟。

效果上,4個模型均實現了跟業界同尺寸模型的對標,其中Hunyuan 7B在數學推理測試DROP上取得85.9分的成績,在AIME2024和AIME2025兩個數學榜單上得分分別為81.1分和75.3分,均排名第一,超過OpenAI o1-mini和Qwen3-8B。

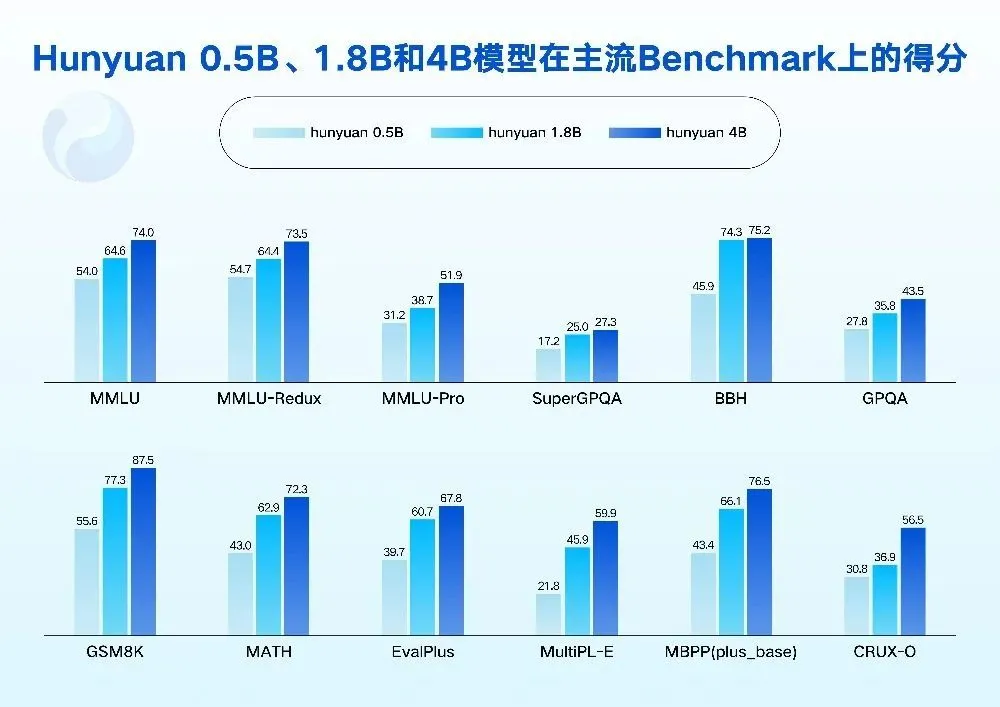

對比Hunyuan 0.5B、1.8B和4B,在推理能力BBH測評中,1.8B的模型的成績只與4B的成績相差0.9分,推理能力不相上下。

這四個模型的亮點在于agent和長文能力,跟此前開源的Hunyuan-A13B模型一樣,騰訊團隊在技術上通過數據構建和強化學習獎勵信號設計,提升了模型在任務規劃、工具調用和復雜決策以及反思等agent能力上的表現,讓模型實際應用中可以更好地完成深度搜索、Excel操作、旅行攻略規劃等任務。

此外,模型原生長上下文窗口達到了256k,意味著模型可以一次性記住并處理相當于40萬中文漢字或50萬英文單詞的超長內容,相當于一口氣讀完3本《哈利波特》,并且能記住所有人物關系、劇情細節,還能根據這些內容討論后續故事發展。

部署上,4個模型均只需單卡即可部署,部分PC、手機、平板等設備可直接接入。并且,模型具有較強的開放性,主流推理框架(例如,SGLang,vLLM and TensorRT-LLM)和多種量化格式均能夠支持。

02 .

已應用到微信讀書

智能座艙和金融AI助手等

應用層面,這4款小尺寸模型都能夠滿足從端側到云端、從通用到專業的多樣化需求,并且已經在騰訊多個業務中應用。

例如,依托模型原生的超長上下文能力,騰訊會議AI小助手、微信讀書AI問書AI助手均實現對完整會議內容、整本書籍的一次性理解和處理。

在端側應用上,騰訊手機管家利用小尺寸模型提升垃圾短信識別準確率,實現毫秒級攔截,保護用戶隱私;騰訊智能座艙助手通過雙模型協作架構解決車載環境痛點,充分發揮模型低功耗、高效推理的特性。

在高并發場景中,搜狗輸入法基于模型的多模態聯合訓練機制使嘈雜環境下提升識別準確率;騰訊地圖采用多模型架構,利用意圖分類和推理能力提升了用戶交互體驗;微信輸入法「問AI」基于模型實現輸入框與AI即問即答的無縫銜接。

在垂直行業應用中,金融AI助手通過Prompt優化和少量數據微調實現超95%意圖識別準確率。依托模型的理解能力,騰訊游戲翻譯和QQ飛車手游NPC,在多語言理解能力、方言翻譯和智能對話方面,有明顯優化,這些能力在專業客服、內容出海以及電商直播等場景有較大應用潛力。

03 .

騰訊開源活躍

覆蓋多模態

最近,全球開源領域異常熱鬧,中國大模型表現搶眼。騰訊混元大語言模型也在持續推進開源,其開源模型已覆蓋文本、圖像、視頻和3D生成等多個模態。

在大語言模型領域,騰訊混元此前陸續開源了激活參數量達52B的Hunyuan large和混合推理MoE(混合專家)模型Hunyuan-A13B,這些模型憑借架構上的創新以及在性能和效果上的不錯表現,在開源社區受到廣泛關注。

多模態方面,混元還開放了完整多模態生成能力及工具集插件,陸續開源了文生圖、視頻生成和3D生成能力,提供接近商業模型性能的開源基座,方便社區基于業務和使用場景定制,圖像、視頻衍生模型數量達到3000個。

上周,騰訊發布并開源混元3D世界模型1.0,這一模型一經發布即迅速登上Hugging Face趨勢榜第二,下載量飆到近9k,混元3D世界模型技術報告還拿下了Hugging Face論文熱榜第一。

04 .

結語:騰訊開源、應用兩手抓

當前全球AI開源生態持續升溫,各大科技公司都在加碼模型開源,騰訊此次動作是其開源戰略的延續。

騰訊混元此次開源4款小尺寸模型,覆蓋了從0.5B到7B的參數范圍,為不同算力需求的場景提供了適配方案,為AI開發者社區提供了更多選擇。